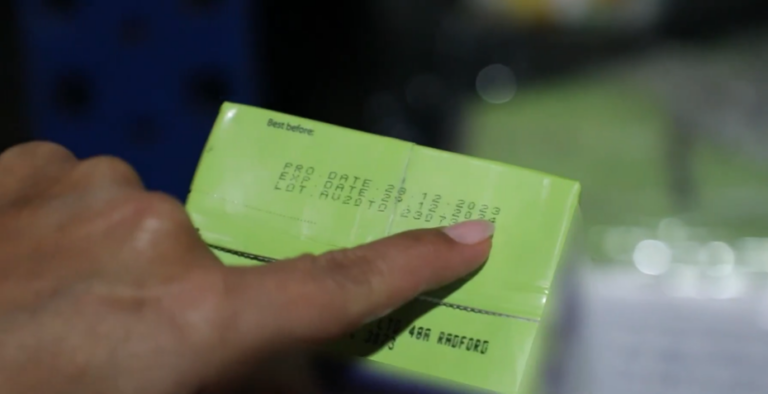

Bakan Yumaklı’dan uyarı: Süresi dolmuş ürünlere yeni etiket basanlar tespit edildi!

2026’da bedelli askerlik ücreti ne kadar olacak? Aralık enflasyon tahmini merak konusu!

A101’de 11 Aralık 2025’te 70 inç TV, su sebili, motosiklet ekipmanları ve bavul fırsatları!

Mert Hakan Yandaş’ın Maçlarına Ait Kupon Görüntüleri Ortaya Çıktı!

TOKİ kura sonuçları ne zaman duyurulacak? 2025 başvuruları için son tarih ne?

Altın fiyatları güncel: 4 Aralık’ta gram, çeyrek, ons ve yarım altın alış-satış değerleri

Emlak Vergisi İkinci Taksitleri İçin Son Tarih ve Gecikme Faizi!

Seferihisar Mandalina Festivali 25. Yılında Neşeyle Gerçekleşti

2026 Ocak’ta memur maaş artışı: En düşük memur ve emekli maaşı ne kadar olacak?